الرئيسية

أخبارعاجلة

رياضة

- الأخبار الرياضية

- أخبار الرياضة

- فيديو أخبار الرياضة

- نجوم الملاعب

- اخبار الرياضة

- ملاعب مصرية

- بطولات

- أخبار الاندية المصرية

- مقابلات

- رياضة عربية

- رياضة عالمية

- موجب

- سالب

- مباريات ونتائج

- كرة الطائرة

- كرة اليد

- كرة السلة

- رمي

- قفز

- الجري

- تنس

- سيارات

- غولف

- سباق الخيل

- مصارعة

- جمباز

- أخبار المنتخبات

- تحقيقات

- مدونات

- أخبار المحترفين

ثقافة

إقتصاد

فن وموسيقى

أزياء

-

صحة وتغذية

-

سياحة وسفر

ديكور

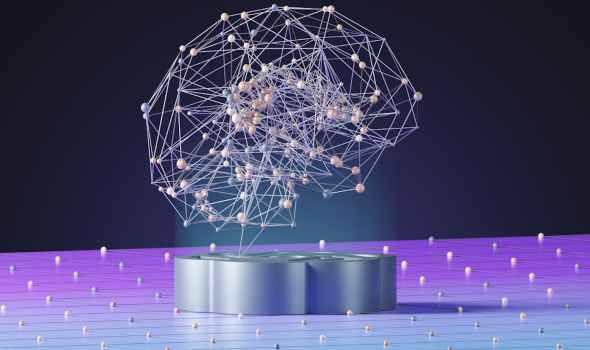

دراسات تحذر برامج الذكاء الاصطناعي قد تضعف التفكير وتؤثر على صحة الدماغ

الذكاء الاصطناعي

واشنطن - مصر اليوم

خلصت دراستان حديثتان إلى أن برامج الذكاء الاصطناعي، مثل "تشات جي بي تي" و"جيميني"، تسبب الضرر لعقل الإنسان ولطريقته في التفكير، كما تُدخل الناس في دوامة من الأفكار المُدمّرة.

وكشفت الدراستان اللتان أجراهما معهد ماساتشوستس للتكنولوجيا وجامعة ستانفورد في الولايات المتحدة، أن برامج المساعدة المبنية على الذكاء الاصطناعي تقدم بانتظام إجابات مُفرطة في التوافق، مما يُلحق ضرراً أكبر من النفع.

وبحسب ما نقله تقرير نشرته صحيفة "ديلي ميل" البريطانية، فقد تبين أنه عندما يطرح الناس أسئلة أو يصفون مواقف تكون فيها معتقداتهم أو أفعالهم خاطئة أو ضارة أو مُضلّلة أو غير أخلاقية، فإن ردود الذكاء الاصطناعي تكون أكثر ميلاً بنسبة 49% للموافقة على رأي المستخدم وتشجيع أوهامه على أنها وجهة النظر الصحيحة، مقارنةً بردود الأشخاص الآخرين.

وحذّر فريق معهد ماساتشوستس للتكنولوجيا من أن برامج الدردشة الآلية المُفرطة في التوافق قد تُسبّب الضرر للمستخدمين الذين يعتمدون عليها للحصول على إجابات وآراء، حيث إنها تؤدي إلى "دوامة من الأوهام"، وهي حالة يصبح فيها الشخص واثقاً جداً من معتقدات غريبة.

ويقول العلماء إنه عندما يتحدث الناس مع برامج الذكاء الاصطناعي مثل (ChatGPT) حول شكوك غريبة تراودهم، كنظرية مؤامرة غير مثبتة أو تم دحضها، تستمر هذه البرامج في الرد بإجابات من قبيل: "أنت محق تماماً". كما تقدم هذه البرامج تعليقات تبدو وكأنها "أدلة" تدعم أوهام المستخدم، فكل موافقة تجعله يشعر بأنه أذكى وأكثر يقيناً بصوابه وخطأ الآخرين. وبمرور الوقت، تتحول هذه الشكوك البسيطة إلى معتقدات راسخة، رغم أن الفكرة خاطئة تماماً.

وقال باحثون في جامعة ستانفورد إن هذه الحلقة المفرغة المدمرة تجعل مستخدمي برامج الدردشة أقل استعداداً للاعتذار أو تحمل مسؤولية السلوكيات الضارة، وأقل حماساً لإصلاح علاقاتهم مع من يختلفون معهم.

وركزت كلتا الدراستين على مشكلة متنامية في برامج الدردشة الذكية تُعرف بـ"التملق"، وهو مدح شخص ما أو آراؤه لدرجة تعتبر غير صادقة أو مجرد محاولة للتملق.

وأراد باحثون من معهد ماساتشوستس للتكنولوجيا اختبار ما إذا كانت روبوتات الدردشة المدعومة بالذكاء الاصطناعي، والتي تتسم بالموافقة المفرطة أو ما يُعرف بـ"الموافقة التلقائية"، قادرة على دفع الناس إلى تصديق أفكار خاطئة بشكل متزايد مع مرور الوقت.

وبدلاً من استخدام أشخاص حقيقيين، قاموا ببناء محاكاة حاسوبية لشخص منطقي تماماً يتحدث مع برنامج ذكاء اصطناعي يحاول دائماً الموافقة على كل ما يقوله. وأجروا عشرة آلاف محادثة وهمية وراقبوا كيف تغيرت ثقة الشخص بعد كل رد من روبوت الدردشة.

وأظهرت النتائج أنه حتى وجود قدر ضئيل من الموافقة من الذكاء الاصطناعي تسبب في ظهور "دوامة من الأوهام" لدى الشخص المُحاكى، أي أنه أصبح واثقاً للغاية من صحة فكرة خاطئة.

وكتب فريق معهد ماساتشوستس للتكنولوجيا في تقريره: "حتى الزيادة الطفيفة جداً في معدل دوامة الأوهام الكارثية يمكن أن تكون خطيرة للغاية".

وحذر الباحثون من أن الدراسة أظهرت أنه حتى الأشخاص العقلانيون والمنطقيون تماماً معرضون للدخول في دوامة من الأوهام إذا لم تُخفف شركات الذكاء الاصطناعي من كمية الردود المُجاملة التي تُقدمها برامج الدردشة الآلية.

قد يهمك أيضــــــــــــــا

مايكروسوفت تضخ 10 مليارات دولار في اليابان لتعزيز الذكاء الاصطناعي والأمن السيبراني

نصيحة "تشات جي بي تي" تسبب تسمم خطير وأزمة صحية لرجل

GMT 16:30 2026 الثلاثاء ,12 أيار / مايو

قلق عالمي من فيروس هانتا وترقب لما قد يحدث في 19 مايوGMT 17:08 2026 الثلاثاء ,28 إبريل / نيسان

دراسة حديثة تكشف تفوق الجراحة على المناظير في استبدال صمامات القلب الصناعيةGMT 17:36 2026 الإثنين ,27 إبريل / نيسان

تأثير خفي للنوم والعمر على الدماغ دراسة تكشف تغيّرات النشاط الكهربائي عبر المراحل العمريةGMT 22:08 2026 السبت ,18 إبريل / نيسان

ما الذي يحدث لجسمك عندما تتوقف عن تناول السكر لمدة ستة أسابيعGMT 17:11 2026 الثلاثاء ,14 إبريل / نيسان

مفاجأة علمية حول أمراض شائعة في مصر تكشفها وزارة الصحةإيران تحدد منطقة للمراقبة العسكرية في مضيق هرمز تشمل المياه الإقليمية بالإمارات وعُمان

طهران ـ مصر اليوم

نشرت الهيئة التنظيمية الإيرانية الجديدة الخاصة بمضيق هرمز، خريطة جديدة تحدد المنطقة الخاضعة لـ'إشراف' قواتها المسلحة، والتي تشمل مناطق بالمياه الإقليمية لكل من دولة الإمارات العربية المتحدة وسلطنة عُمان. ...المزيدأحمد عز يكشف تفاصيل فيلم 7Dogs ويصفه بتجربة سينمائية عالمية

القاهرة - مصر اليوم

تحدث الفنان أحمد عز عن أحدث أعماله السينمائية "7dogs"، المقرر طرحه في دور العرض السينمائي يوم 27 مايو الجاري ضمن أفلام موسم عيد الأضحي 2026، وذلك خلال اليوم الإعلامي لأبطال الفيلم قبل العرض الخاص المرتقب مساء اليوم ...المزيدالصين تُطلق مهمة فضائية مأهولة تمهيدا لإرسال رواد إلى القمر

بكين ـ مصر اليوم

الصين المركبة الفضائية “شنتشو 23” التي التحمت بنجاح بمحطتها الفضائية، في خطوة تأتي تمهيدا لإرسال أول رحلة صينية مأهولة إلى القمر بحلول العام 2030. خلال هذه المهمة، من المقرر أن يقضي رائد فضاء صيني عاما كاملا ف...المزيدبيع قطعة من سلم برج إيفل بمبلغ 450 ألف يورو في مزاد علني

باريس - مصر اليوم

بيعت قطعة أثرية من سلم برج إيفل، تتكون من 14 درجة، مقابل 450 ألفًا و160 يورو، وفق ما أعلنته دار المزادات آرتكوريال اليوم. وتتمثل القطعة في جزء من سلم حلزوني يبلغ ارتفاعه 2.75 متر، ويعود تاريخه إلى عام 1889، وكان يربط بين الط...المزيدمحمد صلاح يصنع هدفًا ويغادر باكيًا وسط تصفيق جماهير ليفربول بعد التعادل مع برينتفورد

لندن ـ مصر اليوم

Maintained and developed by Arabs Today Group SAL

جميع الحقوق محفوظة لمجموعة العرب اليوم الاعلامية 2025 ©

Maintained and developed by Arabs Today Group SAL

جميع الحقوق محفوظة لمجموعة العرب اليوم الاعلامية 2025 ©

أرسل تعليقك